On souhaite au LiDAR de l'iPhone 12 Pro un meilleur sort que son prédécesseur de l'iPad Pro qui, pour le dire assez clairement, ne sert pas à grand chose en dehors d'usages très ponctuels ou pour certains professionnels. C'est un peu mieux engagé, Apple ayant non seulement vanté des expériences de réalité augmentée plus immersives, mais aussi une mise au point automatique plus rapide en basse lumière.

Une des premières applications à annoncer le support du LiDAR, c'est (évidemment, serait-on tenté de dire) Snapchat. Le capteur donne à la caméra de l'app des informations de maillage de l'espace qui permet aux Lenses (les filtres Snapchat) de mieux comprendre la géométrie des surfaces et des objets qui font face à l'utilisateur.

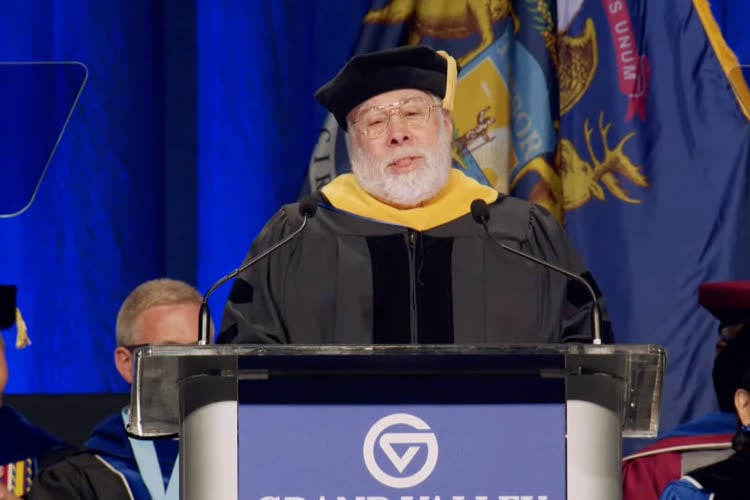

Pour l'occasion, le réseau social et Apple ont collaboré afin d'atteindre « un nouveau niveau de créativité pour la réalité augmentée », explique Eitan Pilipski, vice-président de la plate-forme caméra de Snap. Les créateurs pourront jouer avec le LiDAR de l'iPhone pour concevoir leurs Lenses, avec l'aide de Lens Studio 3.2 qui intègre un nouveau mode de prévisualisation.

Bonus : il n'est pas nécessaire d'avoir un iPhone 12 Pro pour créer des Lenses compatibles (ça va mieux en le disant). Et sur l'iPad Pro 2020 aussi, il est possible d'utiliser le LiDAR avec Snapchat, bien que l'app ne soit pas optimisée pour les grands écrans. Pour mettre le pied à l'étrier, Snap propose des templates à utiliser dans Lens Studio.