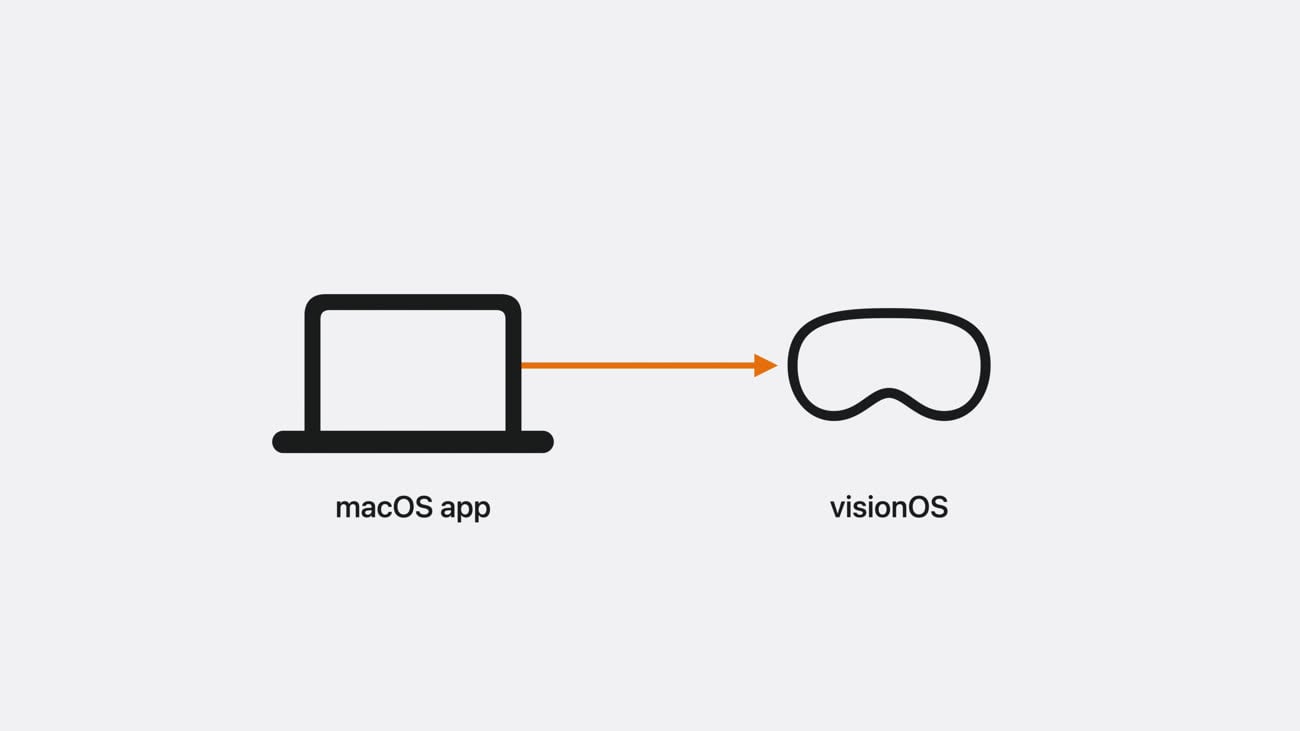

« Tahoe » rime avec « Vision Pro » : avec le framework CompositorServices, les applications macOS pourront envoyer des scènes tridimensionnelles vers le casque, sans besoin d’une application visionOS. SwiftUI permet maintenant de concevoir des interfaces volumétriques, de manipuler des objets virtuels et de projeter des éléments dans l’espace. Pour un peu, on dirait qu’Apple prépare l’arrivée d’un casque directement relié au Mac…

Cela tombe bien, « Apple travaille sur un Vision Pro qui se branche sur un Mac », selon Mark Gurman, le journaliste toujours bien renseigné de Bloomberg. Avec macOS 26 et visionOS 26, les développeurs pourront créer des applications qui tournent sur le Mac, mais affichent des contenus sur le casque. N’y voyez pas une manière de concevoir des applications spatialisées au rabais ; il s’agit plus probablement de faciliter la conception de contenus tridimensionnels.

Une application de modélisation architecturale, par exemple, pourrait permettre de travailler sur la visualisation 2D sur l’écran du Mac tout en projetant une visualisation 3D dans le casque. Puisque la même application gère les deux environnements, la manipulation de l’un pourra directement influer sur l’autre, sans latence ni désynchronisation. Voilà qui pourrait encore renforcer l’intérêt pour le Vision Pro dans les milieux industriels.